近年、企業にとってデータ活用は、市場での競争力を高めるうえで必須の経営戦略となりつつあります。

市場の変化が激しく、勘や経験だけに頼った意思決定が難しくなる中で、客観的なデータに基づく経営判断を行う「データドリブン経営」の重要性がますます高まっています。

一方で、現場からはこんな声も多く聞かれます。

- 何から始めればいいのか分からない・・・

- データはあるけど、上手く活用できていない・・・

- 分析の進め方や手順に自信がない・・・

データ分析は、単なる数値の集計にとどまらず、課題の発見や意思決定の精度向上、さらには新たなビジネスチャンスの創出につながる重要な取り組みです。

その効果を最大限に引き出すためには、適切な進め方と手法を理解し、継続的に取り組んでいくことが欠かせません。

そこで今回は、データ分析の目的やメリット、進め方、代表的な分析手法、活用できるツール、成功のポイント、そして情シス部門に求められる役割までを分かりやすく解説します。

これからデータ分析に取り組みたい方はもちろん、改めて全体像を整理したい方にも役立つ内容となっていますので、ぜひ最後までご覧ください。

ICT × Optimization × Navigator = ION(イオン)

情シスが「1人で抱え込まない」環境を実現します

情シスの「誰か手伝って・・・」を現実に。

あなたの頼れる”ナビゲーター”として、共に最適解を見つけ出します。

システム企画から運用・保守、インフラ管理、セキュリティ対策、Microsoft 365活用まで、ITまわりの「困った」を幅広くサポートいたします。

「全部任せたい」も、

「この部分だけ手伝ってほしい」もOK。

専門性の高いものから定常的な作業まで、情シス業務の中から必要な部分だけを柔軟にご依頼いただけます。

目次

1.データ分析とは

データ分析とは、収集したデータを整理・加工・分析し、そこから有益な情報(インサイト)を導き出す一連のプロセスを指します。

売上データや顧客情報、Webサイトのアクセスログ、実験結果など、さまざまなデータから知見を得て、現状の把握や課題の発見、将来予測、意思決定の最適化に活用します。

単なる数値の集計やグラフ化にとどまらず、「仮説を立てる→分析する→結果を解釈する」といった一連のプロセス全体が含まれる点が特徴です。

データ分析は「客観的な事実に基づく判断」を実現するための重要な手段であり、人の勘や経験だけでは見えにくい傾向・パターンを明らかにし、ビジネスや研究を前進させる役割を担います。

近年はDX(デジタルトランスフォーメーション)の推進に伴い、その重要性はますます高まっており、データに基づく意思決定を支える基盤として幅広い分野で活用されています。

データ分析の目的

データ分析の目的は、分析結果をもとに何かしらの策を立てて行動を起こし、ビジネス上の課題を解決することです。

データ分析は、データから現状の課題を把握するための「手段」であり、それ自体が目的ではありません。

重要なのは、分析によって得られた結果をもとに、具体的なアクション(施策)につなげることです。

企業におけるデータ分析は、売上や顧客情報、業務プロセスなどの数値データをもとに、現状とあるべき姿のギャップを明らかにし、課題を特定することから始まります。

その後、課題の背景にある原因についてデータをもとに仮説を立て、改善策の検討・実行へとつなげていきます。

この一連のプロセスを通じて、従来の勘や経験だけに頼らず、客観的なデータに基づいて迅速に経営判断を下す「データドリブン経営」が可能になり、意思決定の精度やスピードの向上に加え、新たなビジネスチャンスの発見にもつながります。

データ分析の重要性が高まっている背景

近年、企業においてデータ分析が重視されるようになった背景には、次のようなビジネス環境の大きな変化が挙げられます。

データ量の増加

インターネットやスマートフォン、IoT機器の普及により、企業が取り扱うデータ量は急速に増え続けています。

顧客の属性や購買履歴、Webサイトの行動履歴など、あらゆる情報がデータとして日々蓄積されており、これらのデータをいかに活用できるかどうかが企業の競争力を左右するポイントとなっています。

分析技術の発展

クラウドやAI、機械学習技術の進化により、高度なデータ分析が以前よりも手軽に実施できるようになりました。

専門知識が少なくても活用できるツールも増え、多くの企業がデータ分析に取り組める環境が整いつつあります。

競争環境の激化

市場の変化が激しく、顧客ニーズも多様化する中で、過去の経験や勘だけに頼った意思決定では通用しなくなっています。

客観的なデータに基づいて現状を正確に把握し、迅速に判断することが、競争優位性を確立するために欠かせなくなっています。

DX(デジタルトランスフォーメーション)の推進

近年、AIやIoTなどのデジタル技術を活用し、業務プロセスやビジネスモデルを変革して競争優位性の確立を目指す「DX(デジタルトランスフォーメーション)」の取り組みが加速しています。

企業が蓄積した膨大なデータから価値を引き出し、競争力を高める手段として、データ分析の役割と重要性はますます高まっています。

2.データ分析のメリット

データ分析がもたらす具体的なメリットとしては、次のようなものが挙げられます。

- 根拠に基づいた課題発見ができる

- 意思決定のスピードと精度が向上する

- 将来予測の精度が高まる

- データドリブン経営を実現できる

- 業務効率化・生産性向上につながる

- 深い顧客理解に基づくサービス提供が可能になる

- 新たなビジネスチャンスを発見できる

根拠に基づいた課題発見ができる

データ分析を行うことで、感覚や主観に頼らず、客観的な視点で現状を正確に把握できるようになります。

定量的なデータに基づいて状況を整理することで、先入観や思い込みに左右されることなく、真に解決すべき本質的な課題を特定できます。

また、膨大なデータの中から人力では気づきにくいパターンや相関関係を捉えられる点も特徴で、これまで見落としていた課題の発見にも役立ちます。

意思決定のスピードと精度が向上する

データに基づいた明確な判断基準を持つことで、議論のブレや迷いが減り、迅速な意思決定が可能になります。

さらに、根拠となるデータを提示できるため、社内の合意形成もスムーズに進みます。

変化の激しいビジネス環境において、スピードと精度を両立した意思決定を実現できる点は大きなメリットです。

将来予測の精度が高まる

過去のデータや顧客の行動履歴を分析することで、需要や売上の予測精度を高めることができます。

蓄積されたデータから傾向やパターンを把握することで、将来の動きをより具体的に見通せるようになります。

例えば、過去の販売実績や季節性、トレンド、天候などの外部要因を踏まえた商品の需要予測により、生産計画の最適化や過剰在庫/欠品の防止につなげられます。

データドリブン経営を実現できる

データ分析により、過去の経験や勘といった主観的な判断に依存しない、データに基づく意思決定(=データドリブン経営)が実現できます。

客観的なデータに基づく意思決定により、市場や顧客ニーズの変化に応じた最適な判断が可能となり、経営の安定性と再現性の向上につながります。

業務効率化・生産性向上につながる

業務プロセスや生産ライン、在庫データなどを分析することで、ムダや非効率な部分を可視化できます。

データ分析により業務の最適化やリソース配分の見直しが進み、生産性向上やコスト削減が期待できます。

深い顧客理解に基づくサービス提供が可能になる

顧客の属性や行動データ、購買履歴などを分析することで、個々のニーズや嗜好をより具体的に把握できます。

得られたデータをもとに、顧客一人ひとりに合った最適な商品やサービス、情報を提供できるようになり(=パーソナライズ)、顧客満足度やリピート率の向上が期待できます。

新たなビジネスチャンスを発見できる

異なる複数のデータを組み合わせて分析することで、これまで見えていなかった関係性や隠れたパターン、傾向、要因(=インサイト)を明らかにし、市場ニーズや新たな可能性を捉えられるようになります。

データ分析によって得られる「インサイト」とは、単なる数値や事実の把握にとどまらず、そこから導き出される本質的な気付きや示唆のことです。

こうしたインサイトをもとに、新商品・サービスの開発や新規事業の創出につなげることで、企業の成長機会を広げることができます。

3.データの種類

データ分析を行う上で、まず理解しておきたいのが「データの種類」です。

データは、その性質や切り口によっていくつかの観点で分類されます。

違いを正しく理解することで、目的に応じた適切な分析手法を選択でき、より精度の高い意思決定につながります。

| 分類の観点 | 分類内容 | 対象範囲 | 説明 |

|---|---|---|---|

| 性質による分類 | 質的データ/ 量的データ |

全データ | データの基本的な性質による分類 |

| 値の性質による分類 | 離散データ/ 連続データ |

量的データのみ | 数値の取り方 (とびとび or 連続的)による分類 |

| 時間軸による分類 | 横断データ/ 時系列データ |

質的・量的どちらも | データが「一時点」or 「時間の推移」かによる分類 |

| 取得方法による分類 | 一次データ/ 二次データ |

質的・量的どちらも | データの入手方法による分類 |

質的データ/量的データ

「データの性質(中身の違い)」で分類すると、「質的データ」と「量的データ」に大きく分けられます。

質的データ(質的変数)

数値ではなく、属性やカテゴリを表すデータです。

主に分類やグルーピングに用いられます。

例:性別、職業、都道府県、商品カテゴリ など

質的データは、さらに以下2つに分類されます。

- 名義尺度

順序を持たないカテゴリデータ

(例:血液型、居住地、性別)

順序尺度

順序やランキングに意味があるデータ

(例:満足度(満足・普通・不満)、順位)

量的データ(量的変数)

数値として測定でき、大小や差に意味を持つデータです。

計算や統計分析に適しています。

例:売上、年齢、身長、アクセス数 など

量的データは、さらに以下2つに分類されます。

- 間隔尺度

データ同士の「差」に意味がある

(例:気温(℃)、西暦、偏差値)

- 比例尺度

データ同士の「差」と「比」の両方に意味があり、絶対的なゼロが存在する

(例:売上金額、年齢、体重、数量)

離散データ/連続データ

量的データをさらに細分化し、「値の取り方(数値の性質)」で分類すると、「離散データ」と「連続データ」に大きく分けられます。

- 離散データ(離散変数)

とびとびの値を取るデータ

(例:人数、個数、サイコロの出目)

- 連続データ(連続変数)

なめらかに連続した値を取るデータ

(例:身長、体重、温度)

横断データ/時系列データ

データを「時間軸との関係」で分類すると、「横断データ」と「時系列データ」に大きく分けられます。

質的データ・量的データどちらにも使える分類です。

- 横断データ(クロスセクションデータ)

ある一時点における複数対象のデータ

(例:2024年時点の都道府県別人口)

- 時系列データ

同一対象の時間的な推移を表すデータ

(例:過去10年間のA社売上推移)

一次データ/二次データ

データを「取得方法(出どころ)」で分類すると、「一次データ」と「二次データ」に大きく分けられます。

質的データ・量的データどちらにも使える分類です。

- 一次データ

自ら収集したデータ

(例:アンケート、インタビュー、実験データ)

- 二次データ

すでに公開・販売されているデータ

(例:政府統計、調査レポート、Webデータ)

ICT × Optimization × Navigator = ION(イオン)

情シスが「1人で抱え込まない」環境を実現します

情シスの「誰か手伝って・・・」を現実に。

あなたの頼れる”ナビゲーター”として、共に最適解を見つけ出します。

システム企画から運用・保守、インフラ管理、セキュリティ対策、Microsoft 365活用まで、ITまわりの「困った」を幅広くサポートいたします。

「全部任せたい」も、

「この部分だけ手伝ってほしい」もOK。

専門性の高いものから定常的な作業まで、情シス業務の中から必要な部分だけを柔軟にご依頼いただけます。

4.データ分析の進め方

データ分析の基本的なフローは次の通りです。

- 目的・問題の明確化

- 課題の特定・仮説設定

- データの収集・前処理

- データの分析・可視化

- 結果の解釈・施策立案

- 施策の実行・効果検証

- 振り返り・改善(PDCA)

なお、データ分析は単発(スポット)で終わらせず、結果をもとに施策を実行し、その効果を検証しながら改善を繰り返していくことが重要です。

こうした継続的なPDCAサイクルを回すことで、データに基づく意思決定の精度を高め、ビジネスの成果向上につながります。

①目的・問題の明確化

まずは、なぜデータ分析を行うのか、データ分析によって何の問題を解決したいのか、その目的を明確にします。

データ分析はあくまで「手段」であり、目的が曖昧なまま進めてしまうと、分析の方向性が定まらず、結果を有効活用できないケースがあるためです。

例:

- 売上低下の要因を、期間・商品・顧客属性などの観点から分解して特定したい

- 新規顧客を獲得するために、有効な集客チャネルや施策を明らかにしたい

- 顧客単価を向上させるために、購買パターンや関連商品の傾向を分析したい

問題を正しく特定し、解決につなげるためには、現状(As-Is)と目標(To-Be)のギャップを可視化することが欠かせません。

- 過去との比較(例:前年同月比で売上が減少している)

- 他社との比較(例:競合と比べて成約率が低い)

- 目標との比較(例:設定したKPIに対して未達となっている)

可視化されたギャップこそが「解決すべき真の問題」であり、過去・他社・目標との比較を通じて「どこに問題があるのか」を具体的に把握し、分析の出発点を定めます。

②課題の特定・仮説設定

次に、問題の原因となる「課題」を洗い出し、なぜその課題が生じているのか仮説を立てます。

ここでいう「課題」とは、問題を引き起こしている要因のことであり、1つの問題の背後には複数の課題が存在しているケースが一般的です。

課題を整理する際は、要素を構造的に分解して考える方法が効果的です。

例えば、「売上=単価×客数」として表し、単価や客数という各要素に注目して個別に分析すると、どこにボトルネックがあるのかを把握しやすくなります。

例:

<問題>

売上が落ちている

<課題>

- 顧客数が減少している

- リピーターが減少している

- 1人あたりの購入単価が下がっている

課題は複数存在するため、ビジネスへの影響や実現可能性を踏まえ、優先的に取り組むべき課題を決めます。

課題の洗い出しと優先順位の整理ができたら、「なぜその課題が発生しているのか」という原因の仮説を立てます。

例:

- 来店数が減少している

→広告流入が減っているのではないか - 1人あたりの購入単価が下がっている

→値引き施策の影響ではないか

仮説は必ずしも正しい必要はありませんが、データで検証できる形にしておくことが重要です。

どのデータを使って確認するのかまで考えておくことで、その後の分析をスムーズに進められます。

また、仮説の精度を高めるためには、現場担当者へのヒアリングや既存データの確認も有効です。

数値データだけでなく、現場の感覚といった定性情報からもアプローチすることで、より実態に即した仮説を立てることができます。

③データの収集・前処理

仮説を検証するために必要なデータを収集します。

分析の目的や仮説の内容に応じて、必要なデータを過不足なく揃えることが重要です。

【主なデータの例】

- 売上データ(商品別・チャネル別・期間別など)

- 顧客データ(属性情報、購買履歴など)

- Webアクセスログ(流入経路、閲覧ページ、離脱率など)

- 外部の市場データ(業界動向、競合情報など)

これらのデータは、社内外の複数のシステムに分散しているケースも多いため、必要に応じて統合して扱う必要があります。

ただし、収集したデータはそのままでは分析に適さない場合が多く、前処理(データクレンジング)が欠かせません。具体的には次のような作業を行います。

- 欠損値(空欄データ)の削除/補完

- 誤入力や異常値(外れ値)の修正

- 重複データの削除

- フォーマットの統一(表記ゆれ/単位/日付形式などの統一)

データの質が分析結果の精度を大きく左右するため、クレンジング作業の工程は特に重要です。

質の低いデータが混ざった状態で分析を行うと、誤った分析結果や意思決定につながるリスクがあるため、丁寧なデータ整備が求められます。

④データの分析・可視化

整備したデータをもとに、目的や仮説に応じた分析を行います。

分析では、データの傾向や関係性を明らかにし、課題が生じている原因や改善のヒントを導き出します。

詳しくは後述しますが、主な分析手法としては次のようなものがあります。

- クロス集計:年齢/性別/地域などの属性ごとに結果を比較し、傾向の違いを把握する

- 相関分析:項目同士の関係性を確認し、関連の強さを把握する

- 回帰分析:売上と広告費の関係など、どの要因がどの程度影響しているかを分析する

- クラスター分析:似ている特徴を持つデータ同士をグループ化し、それぞれの傾向を把握する

重要なのは、高度な手法を使うことではなく、目的や仮説に適した手法を選ぶことです。

まずはシンプルな集計や比較から始め、必要に応じて分析を深めていくのが効果的です。

なお、分析結果をグラフやダッシュボードを活用して可視化すると、数値だけでは把握しづらい傾向やパターンも直感的に理解しやすくなります。

例:

- 棒グラフ・円グラフ:項目ごとの割合や比較を把握する

- 折れ線グラフ:売上やアクセス数などの時系列の推移を確認する

- 散布図:2つの指標の関係性(相関)を視覚的に捉える

さらに、BIツール(Business Intelligenceツール)を活用することで、データの集計・分析・可視化を一元的に行うことができ、複雑なデータもリアルタイムに分かりやすく共有できます。

データの「見える化」が進むことで、関係者の間で共通認識が形成され、よりスムーズに意思決定を行えるようになります。

⑤結果の解釈・施策立案

分析結果をもとに、数値の変化や傾向がビジネスにとって何を意味するのかを読み取り、具体的な施策へと落とし込みます。

単に「数値が上がった/下がった」といった事実を把握するだけでなく、「なぜその変化が起きているのか」「今後どのようなアクションにつなげるべきか」を考えることが重要です。

例:

- 特定の顧客層の離脱率が高い

→ターゲットや訴求内容の見直し、サービス改善の検討 - 広告費と売上に相関がある

→効果の高いチャネルへの投資配分の最適化 - 特定の時間帯に売上が伸びている

→キャンペーンや人員配置の最適化

分析結果を単なる「気付き」で終わらせず、具体的なアクションプランに変換することが成果への近道です。

また、施策を検討する際には、実現可能性やコスト、期待される効果も踏まえ、優先順位を付けることが重要です。

分析結果だけに依存せず、現場の知見や市場環境なども考慮し、総合的に施策を決定することが求められます。

⑥施策の実行・効果検証

施策の立案後は、優先度の高いものから順に実行していき、その効果を定量的に測定します。

施策の効果を正しく評価するためには、どの指標(KPI)で評価するのか、何をもって成功と判断するのか、実行前の段階で評価軸をあらかじめ明確にしておくことが重要です。

評価基準が曖昧なまま進めると、結果の解釈がブレてしまい、その後の意思決定につながりにくくなります。

また、施策の効果をより正確に把握するためには、比較対象を設けることも効果的です。

例えば、施策を実施したグループと未実施のグループを比較することで、施策による純粋な効果を把握しやすくなります(A/Bテストなど)。

そのほか、必要に応じて統計手法を用いて有意差を検証することで、データ間の差が偶然によるものではなく、実質的な意味を持つものかどうかを客観的に判断できます(t検定など)。

⑦振り返り・改善(PDCA)

最後に、実施した施策の結果を振り返り、次の改善へとつなげます。

施策は実行して終わりではなく、その結果から学びを得て、次のアクションに活かすことが重要です。

【振り返りの例】

- 成功要因の特定:どの要素が成果につながったのか明らかにする

- 失敗要因の分析:期待した成果が出なかった理由や改善点を洗い出す

- ナレッジの蓄積:得られた知見や気付きを記録し、チーム内で共有する

成功・失敗に関わらず振り返りを行うことで、次の施策の精度を高めることができます。

個人の経験にとどめず、組織全体のナレッジとして蓄積・活用していくことも重要です。

振り返りの内容をもとに仮説や施策を見直し、実行・検証を繰り返すことで、継続的な改善サイクルを回していきます。

振り返り→改善→再実行のPDCAサイクルを積み重ねることで、データ活用の精度が高まり、安定して成果を出せる状態へとつながっていきます。

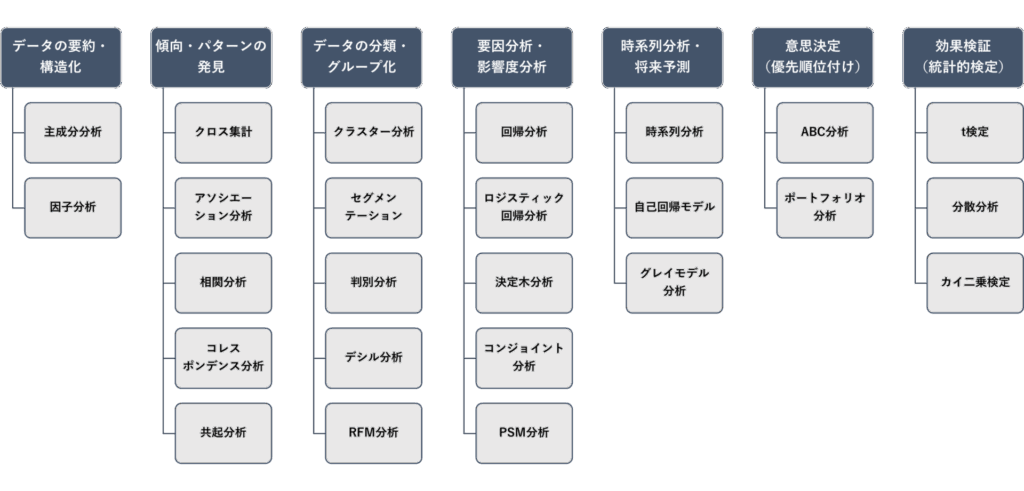

5.【目的別】代表的なデータ分析手法

データ分析手法は数多く存在しますが、関係性の把握やグループ分け、要因分析など、目的に応じて適切な手法を選択することが重要です。

ここでは、代表的なデータ分析手法を「目的別」に7つのカテゴリに整理してご紹介します。

①データの要約・構造化

複雑なデータを整理し、全体像や本質を把握しやすくするための手法です。

膨大な情報の中から必要な要素を抽出して整理・構造化(インデックス化)することで、データの意味を解釈しやすい形にします。

主に、分析の前処理や特徴把握の段階で活用されます。

■主成分分析(PCA)

複数の変数を、少数の「主成分」と呼ばれる代表的な指標にまとめることで、データをシンプルにする手法です。

例えるなら、テストの「国語・数学・英語」の点数を「総合的な学力」という1つの軸で表すようなイメージです。

複雑なデータの中から重要な特徴だけを抽出することで、データ全体の傾向を掴みやすくなります。

データの可視化(グラフ化)や特徴把握の際によく活用されます。

■因子分析

複数の変数に共通して影響を与えている「目に見えない要因(因子)」を抽出する手法です。

一見バラバラに見えるデータでも、「実は同じ理由で評価されている」という背景を明らかにできます。

主成分分析と似ていますが、データの要約よりも「意味のある共通因子」を発見することに重点を置きます。

顧客満足度調査や心理分析において、「価格志向」「ブランド志向」のように、表には現れにくい隠れたニーズや価値観の把握に活用されます。

②傾向・パターンの発見

データ同士の関連性や隠れた傾向・パターンを明らかにするための手法です。

「どのデータとどのデータが関係しているのか」「どのような組み合わせや傾向があるのか」を把握することで、現状理解や仮説の構築に役立ちます。

主に、顧客分析の初期段階でよく用いられます。

■クロス集計

複数の項目を組み合わせて集計し、データ同士の関係性を可視化する手法です。

例えば「年代×購買有無」「性別×商品カテゴリ」のように、2つ以上の視点から分析することで、属性ごとの傾向や違いを把握できます。

シンプルながら非常に汎用性が高く、データ分析の初期段階でよく用いられる基本的な手法です。

■アソシエーション分析(バスケット分析)

「どの商品とどの商品が一緒に購入されやすいか」など、商品やデータの中から「一緒に選ばれやすい組み合わせ」を見つける手法です。

POSデータなどを活用し、「パンを買う人は牛乳も一緒に買いやすい」といった購買パターンを明らかにします。

クロスセル(追加購入の促進)やレコメンド(おすすめ)機能、売り場のレイアウト設計などに活用され、売上向上に直結しやすい分析手法です。

■相関分析

2つの数値データの関係性の強さを、相関係数によって定量的に評価する手法です。

相関係数は-1~1の範囲を取り、1に近いほど強い正の相関(一方が増えるともう一方も増える)、-1に近いほど負の相関(一方が増えるともう一方は減る)を示します。

例えば、「広告費と売上」「気温と売上」など、2つのデータの関係性を把握する際に用いられます。

ただし、相関があっても因果関係があるとは限らない点には注意が必要です。

■コレスポンデンス分析

アンケート調査などのクロス集計表をもとに、データ同士の関係性を二次元の散布図上にマッピングして可視化する手法です。

例えば、「ブランド/顧客属性」や「商品/評価項目」を位置関係として可視化することで、どの組み合わせにおいて関係性が強いかを直感的に把握できます。

数値の一覧では分かりにくい傾向も、マップ上の距離や配置を見ることで理解しやすくなり、ブランドのポジショニング分析や顧客イメージの把握などに活用されます。

■共起分析

テキストデータの中で、「どの単語が一緒に使われやすいか」を分析する手法です。

SNS分析やアンケートの自由記述分析などでよく活用されます。

例えば、レビューやSNS投稿を分析すると「使いやすい/デザインが良い」という言葉がよく一緒に出てくる、といった傾向を把握できます。

単語同士の組み合わせを分析することで、顧客の関心や潜在ニーズの理解に役立ちます。

③データの分類・グループ化

類似した特徴を持つデータをまとめ、グループ分けする手法です。

顧客や商品をタイプ別に分類することで、各グループの特徴や傾向を把握しやすくなります。

主に、ターゲット別の戦略設計や施策立案などに活用できます。

■クラスター分析

類似するデータ同士を自動的にまとめ、集団(クラスター)としてグループ分けする手法です。

あらかじめ分類基準を設定する必要はなく、データの特徴に基づいて「自然なグループ」が形成されるため、データに潜む見えにくい傾向や共通点を自動的に見つけ出せます。

主に顧客セグメンテーションや市場分析に活用され、グループごとに最適な施策を検討できます。

■セグメンテーション

共通の属性や行動傾向に応じて、顧客をさまざまなグループ(セグメント)に分類する方法です。

「地理(地域・気候など)」「人口(年齢・性別・職業など)」「心理(価値観・趣味など)」「行動(購買頻度・購入経路など)」の主に4つの基準で分類します。

ターゲット選定や戦略設計において基盤となる考え方です。

■判別分析

あらかじめ定義されたグループに対して、新しいデータがどのグループに当てはまるかを判断する手法です。

例えば、過去のデータをもとに「優良顧客/一般顧客」や「合格/不合格」といった基準を学習し、新しいデータがどのグループに属するかを予測します。

品質チェックや顧客のランク分けなど、「どの分類に当てはまるか」を判断したい場面でよく活用されます。

■デシル分析

顧客を購買金額の多い順に並べ、上位から順に10グループに分けて分析する手法です。

どのグループが売上にどれだけ貢献しているかを把握することで、「売上の大部分はどの顧客層が支えているのか」を明確にできます。

優良顧客の特定や、どの層に重点的にアプローチすべきかといったマーケティング施策の最適化に活用されます。

■RFM分析

顧客を「最終購入日(Recency)」「購入頻度(Frequency)」「購入金額(Monetary)」という3つの視点で評価する手法です。

顧客のロイヤルティを可視化でき、優良顧客の維持や休眠顧客の掘り起こしなどに役立ちます。

④要因分析・影響度分析

ある結果(売上減少、不良品発生など)をもたらした要因やその影響度を明らかにする手法です。

「なぜこの結果になったのか」をデータから定量的に把握することで、問題を引き起こしている真の原因を特定できます。

■回帰分析(単回帰・重回帰)

ある結果(目的変数)に対して、どの要因(説明変数)がどれぐらい影響を与えているかを分析する手法です。

例えば、「売上」がどの程度「広告費」や「気温」などの影響を受けているかを数値で把握できます。

1つの要因で分析する場合を単回帰分析、複数の要因を組み合わせて分析する場合を重回帰分析と呼びます。

■ロジスティック回帰分析

ある事象が「起こる/起こらない(0 or 1)」という2値になる場合に、その発生確率を予測する手法です。

顧客の購買有無や離脱予測、Web広告のクリック予測などによく用いられます。

例えば、「サービスを解約しそうな顧客」の特徴を事前に把握し、適切な対策を講じることで、実際の離脱を防ぐといった活用が可能です。

■決定木分析(デシジョンツリー)

条件分岐を繰り返しながらデータを分類・予測する手法です。

「もし○○なら→次は△△を判定」といった形で分岐を重ねていき、結果は木のようなツリー構造で表現される点が特徴です。

そのため、どの条件が結果に影響しているのかが視覚的に分かりやすく、要因の組み合わせや重要度を把握するのに適しています。

■コンジョイント分析

商品やサービスを構成する要素(価格・機能・ブランドなど)が、それぞれ顧客の購買行動にどの程度影響を与えるかを分析する手法です。

複数の組み合わせパターンを提示し、「どれを選ぶか」という結果をもとに、ユーザーが何の要素を重視しているのかを可視化できます。

「価格が安い方がよいのか」「多少高くても機能が充実している方がよいのか」といった優先順位を把握できるため、商品設計や価格設定の最適化に役立ちます。

■PSM分析(価格感度分析)

顧客が「どのくらいの価格なら納得して購入するか」を把握し、最適な価格帯を導き出すための手法です。

価格に関する4つの質問(安すぎる/安い/高い/高すぎる)へのアンケート結果をもとに分析を行います。

顧客の心理的な「適正価格」を可視化でき、新製品の価格設定や既存商品の価格見直しに役立ちます。

⑤時系列分析・将来予測

時間の流れに沿ったデータを扱い、将来予測を行う手法です。

過去から現在までの変化のパターンをもとに、今後の動きや傾向を読み取ることができます。

■時系列分析

時間の経過とともに変化するデータを分析し、「どのような流れやパターンがあるか」を把握する手法です。

データを「長期的な傾向(トレンド)」「季節ごとの変動(季節性)」「予測不能な変動(ノイズ)」に分けて捉えることで、変化の特徴を整理します。

例えば、売上データから「全体的に伸びているのか」「特定の時期に増減があるのか」といった動きを把握でき、将来の売上や需要の予測に役立ちます。

■自己回帰モデル(ARモデル)

過去のデータの値をもとに、現在の値を予測する手法です。

「直近の値は過去の値の影響を受けている」という考え方に基づいており、過去のデータパターンから現在や将来の値を推測します。

例えば、直近数日間の売上データを参考にして、今日や明日の売上を見積もるようなイメージです。

時系列分析の中でも基本的な手法の1つで、需要予測や売上予測などに広く活用されます。

■グレイモデル分析

データが少ない状況でも将来の傾向を予測できる手法です。

通常の分析では十分なデータ量が必要ですが、グレイモデル分析は限られた情報からでもパターンを見つけ、今後の動きを推測できる点が特徴です。

新規事業や不確実性が高い領域など、過去データが十分に揃っていない場面でも、わずかな実績データをもとに売上や需要の見通しを立てることができます。

⑥意思決定(優先順位付け)

限られたリソースをどこに集中すべきかを見極めるための手法です。

優先的に取り組むべき課題や施策を明確にし、精度の高い意思決定につなげられます。

■ABC分析(パレート分析)

データを重要度の高い順に並べ、「高(A)・中(B)・低(C)」の3つに分類する手法です。

一般的に、全体の結果の大部分(約80%)は一部の要素(約20%)によって生み出されると言われており(パレートの法則)、ABC分析ではこの考え方をもとに重要な対象を特定します。

例えば、売上の約8割を占める上位2割の商品をAランクとして重点的に管理・販促することで、在庫管理や商品戦略の最適化、利益の最大化が期待できます。

■ポートフォリオ分析

「重要度×満足度」などの2軸でデータを整理し、全体をマップ上に配置して可視化する手法です。

各データを位置関係で捉えることで、「重要なのに満足度が低い=優先的に改善すべき領域」など、取り組むべきポイントを直感的に把握できます。

どの課題から手を付けるべきか整理できるため、施策の優先順位付けに役立ちます。

⑦効果検証(統計的検定)

データ間の差が偶然によるものなのか、それとも実質的に意味のあるものなのかを統計的に判断する手法です。

主に、A/Bテストのような実験手法において、得られた数値の差が「施策の効果」によるものか、単なる誤差に過ぎないのかを見極めるために用いられます。

■t検定

2つのグループ間の平均値に「統計的に意味のある差(有意差)」があるかを判断する手法です。

例えば、「施策の前後で売上が変化したか」や「AパターンとBパターンで成果に差があるか」といった比較に用いられます。

A/Bテストの結果検証など、施策の効果を判断する場面で幅広く活用されます。

■分散分析

3つ以上のグループ間で平均値に有意差があるかを検証する手法です。

t検定が2グループでの比較に使われるのに対し、分散分析は3つ以上の複数グループを同時に比較できる点が特徴です。

例えば、「複数の広告パターンの中でどれが効果的か」や「地域ごとの売上にどれほど差があるか」といった場面で活用されます。

■カイ二乗検定

カテゴリデータ(質的データ)同士に関連性があるかどうかを確認するための手法です。

例えば、「性別によって購買の有無に違いがあるか」など、数値ではなく分類データ同士の関係性を分析する際に用いられます。

クロス集計と組み合わせて活用されることが多く、見た目だけでは判断しにくいデータの偏りや関連性を客観的に判断するのに役立ちます。

ICT × Optimization × Navigator = ION(イオン)

情シスが「1人で抱え込まない」環境を実現します

情シスの「誰か手伝って・・・」を現実に。

あなたの頼れる”ナビゲーター”として、共に最適解を見つけ出します。

システム企画から運用・保守、インフラ管理、セキュリティ対策、Microsoft 365活用まで、ITまわりの「困った」を幅広くサポートいたします。

「全部任せたい」も、

「この部分だけ手伝ってほしい」もOK。

専門性の高いものから定常的な作業まで、情シス業務の中から必要な部分だけを柔軟にご依頼いただけます。

6.データ分析で活用できるツールやソフトウェア

データ分析を効率的に進めるためには、目的やデータ規模などに応じて適切なツールを選定することが重要です。

Excel・スプレッドシート(手軽な分析)

ExcelやGoogleスプレッドシートは、多くの企業で活用されている身近な分析ツールです。

関数やピボットテーブル、フィルタ機能を使うことで、基本的な集計や簡易分析を手軽に行えます。

一方で、大規模データや高度な分析には不向きであり、手作業によるヒューマンエラーのリスクもあります。

チームで利用する際は、ルール整備やバージョン管理が欠かせません。

BIツール(可視化・ダッシュボード)

BI(Business Intelligence)ツールは、データの集約・分析・可視化を一元的に行えるツールです。

プログラミングやSQLの専門知識がなくても、グラフやダッシュボードを直感的に作成できるため、非エンジニアでも扱いやすいのが特徴です。

複数のデータソースを統合し、リアルタイムで状況を可視化できることから、迅速な意思決定を支援するツールとして多くの企業で活用されています。

【代表的なツール】

- Tableau:直感的な操作で高度なダッシュボードを作成可能

- Microsoft Power BI:Excelとの親和性が高く、社内データ活用に強み

- Looker Studio:Google系サービスとの連携に優れた無料ツール

- Domo / Yellowfin:大規模データや分析の自動化に強み

プログラミング言語(Python・R)

PythonやRは、本格的なデータ分析や機械学習に対応できるプログラミング言語です。

大量データの処理や高度な統計分析、可視化まで幅広く対応でき、柔軟な分析環境を構築できます。

Pythonは機械学習やAI開発、汎用的なシステム開発に活用される一方で、Rは統計解析やデータ可視化の分野で強みを発揮します。

自由度が高い一方で、一定の学習コストが必要になるため、導入にはスキル面の考慮が必要です。

データ分析・統計解析ツール(ノーコード/GUI)

プログラミング不要(ノーコード)で、比較的簡単に高度な分析を行えるツールです。

【代表的なツール】

- KNIME:ノーコードで分析フローを構築できるオープンソースツール

- RapidMiner:GUI操作で機械学習やデータ分析を実行可能

- SPSS / SAS:IBMが提供する老舗の統計解析ソフト

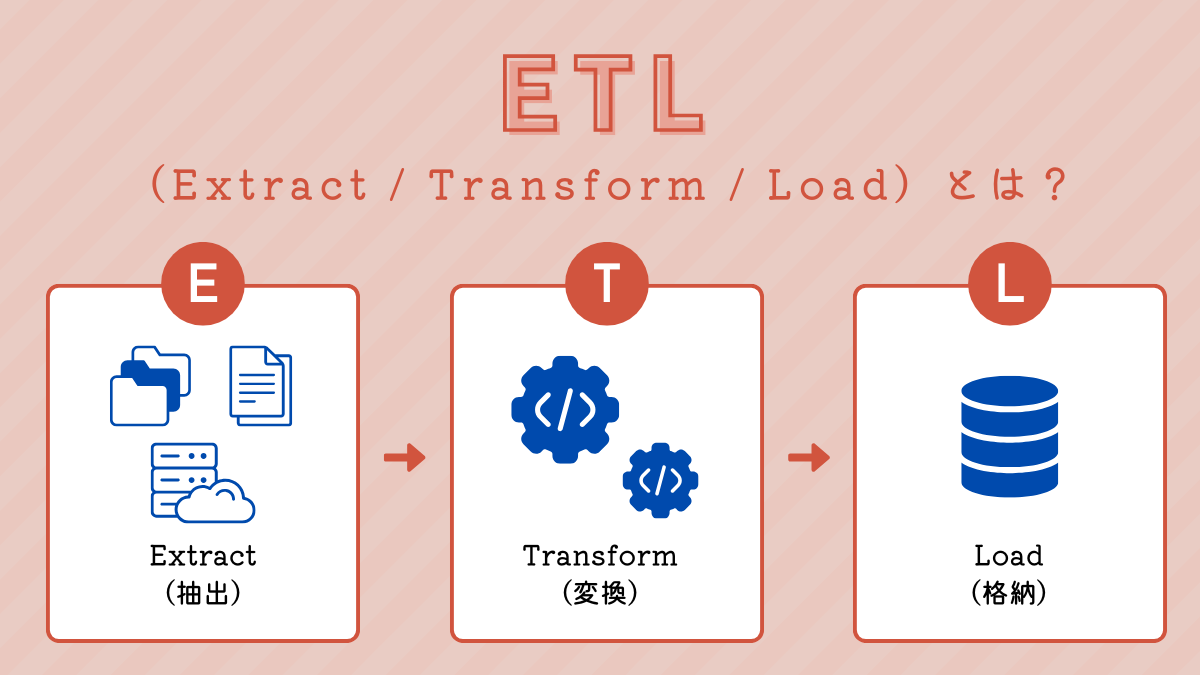

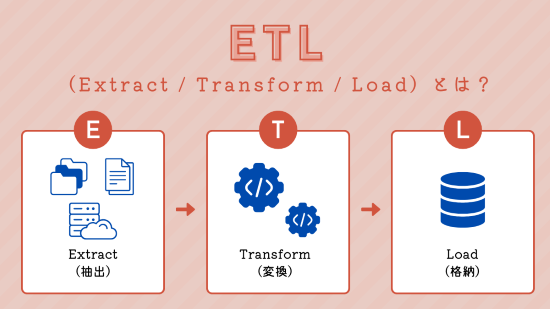

データ収集・加工・基盤ツール

データ分析では、分析そのものだけでなく「データの収集・準備」も重要な工程です。

複数のデータを統合し、分析しやすい形に整えるためのツールも欠かせません。

【代表的なツール】

- スクレイピングツール:Webサイトからデータを自動取得

- ETLツール:データの抽出・変換・格納を自動化

- データウェアハウス(DWH):分析用にデータを蓄積・管理

- BigQuery:大規模データを高速に分析可能

ツール選定のポイント

データ分析ツールは多種多様であり、それぞれ得意とする領域や用途が異なるため、自社の目的や体制に合ったツールを選定することが重要です。

主に以下の観点から比較・検討するとよいでしょう。

- 目的:「可視化」「統計分析」「予測」など、何を実現したいか

- スキル:プログラミングの有無(ノーコード or コーディング)

- データ規模:小規模 or 大規模

- コスト:導入・運用にかかる費用

- 連携性:既存システムやデータソースとの相性

初心者におすすめの始め方

これからデータ分析を始める場合は、いきなり高度なツールに手を付けず、段階的にステップアップいくことで、理解を深めながら無理なくスキルを習得できます。

▼ステップ1

Excelやスプレッドシートを使って、基礎的なデータ分析に慣れる

関数やピボットテーブルを活用しながら、データの集計や整理の方法を理解することで、分析の基本的な考え方を身につけることができます。

▼ステップ2

BIツール(Power BIやLooker Studio等)を活用し、データの可視化を体験

グラフやダッシュボードを作成することで、数値だけでは見えにくい傾向やパターンを直感的に把握できるようになり、分析結果をわかりやすく伝える力も養われます。

▼ステップ3

より高度な分析や予測が必要になった場合は、Pythonなどのプログラミング言語に挑戦

機械学習やデータ処理の自動化など、より実践的で応用的なデータ活用が可能になります。

7.Excelで使える主なデータ分析手法

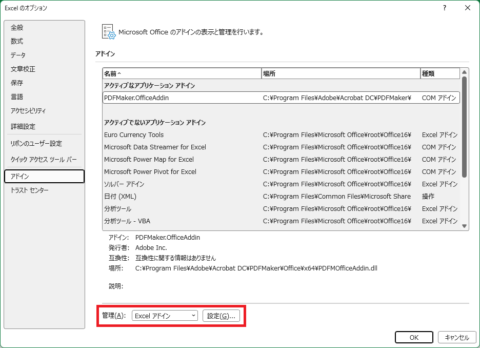

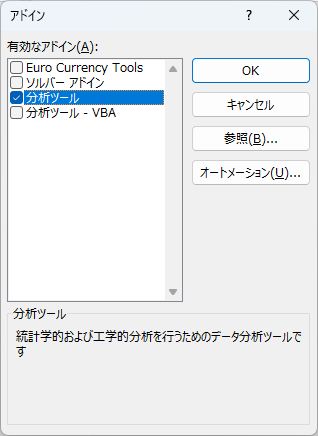

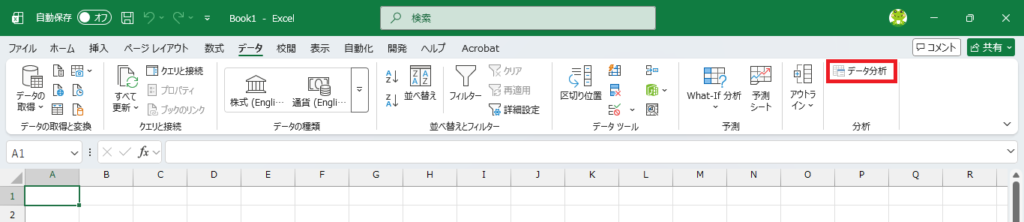

Excelの「データ分析」機能は、デフォルトではオフになっており、オプションのアドイン設定から有効化することで使用できるようになります。

設定手順

①「ファイル」タブ > 「オプション」を開く

②「アドイン」を選択

③下部「管理」で「Excel アドイン」を選択し、「設定」をクリック

④「分析ツール」にチェックを入れて「OK」をクリック

⑤「データ」タブの右端に「データ分析」が表示される

なお、Excelで使える分析手法は次の通りです。

データ分析に慣れるためにも、まずは「基本統計量」「相関分析」「ピボットテーブル」あたりから始めてみるとよいでしょう。

▼データの傾向を把握する

- 基本統計量:平均・中央値・最大値・最小値などを算出し、データ全体の特徴を把握

- ヒストグラム:データの分布(ばらつきや偏り)を可視化

▼関係性を分析する

- 相関分析:2つのデータの関係の強さを確認(例:広告費と売上)

- 回帰分析:複数の要因が結果にどの程度影響しているかを分析

▼グループ間の違いを比較する

- t検定:2つのグループの平均値に差があるかを検証

- 分散分析:3つ以上のグループ間の差を分析

- F検定:2つのグループの分散(ばらつき)の差を検証

▼時系列・トレンドを把握する

- 移動平均:データのばらつきを平滑化し、全体的な傾向を把握

- 指数平滑:直近のデータほど大きな重みを置き、将来の傾向を予測

▼データの整理・分類に使う

- ピボットテーブル:大量データをクロス集計

- ABC分析:売上などの重要度に応じてデータを分類

▼その他の分析

- 共分散:データ同士の変動の方向性を確認

- サンプリング:データの一部を抽出して分析

- フーリエ解析:周期性のあるデータの分析(やや高度)

ICT × Optimization × Navigator = ION(イオン)

情シスが「1人で抱え込まない」環境を実現します

情シスの「誰か手伝って・・・」を現実に。

あなたの頼れる”ナビゲーター”として、共に最適解を見つけ出します。

システム企画から運用・保守、インフラ管理、セキュリティ対策、Microsoft 365活用まで、ITまわりの「困った」を幅広くサポートいたします。

「全部任せたい」も、

「この部分だけ手伝ってほしい」もOK。

専門性の高いものから定常的な作業まで、情シス業務の中から必要な部分だけを柔軟にご依頼いただけます。

8.データ分析を成功させるためのポイント

データ分析を成功させるために重要な考え方やポイントを見ていきましょう。

- まずは「目的」を明確にする

- データを正しく理解する

- 地味だが重要なクレンジング作業を怠らない

- 仮説を立ててから分析する

- 分析手法は目的に合ったものを選ぶ

- 分析結果を行動につなげる

- 完璧よりも改善の積み重ねを重視する

まずは「目的」を明確にする

データ分析で最も重要なのは、「何のために分析するのか」という目的を明確にすることです。

目的が曖昧なまま分析を始めると、分析そのものがゴールになってしまう「手段の目的化」を引き起こし、せっかくの時間とコストを浪費することになります。

最初に目的を明確にすることで、「どのデータを見るべきか」「どんな分析が必要か」が自然と見えてきます。

なお、目的を設定する際は、「売上を伸ばす」といった抽象的な表現ではなく、数値化された具体的な目標(KPI)に落とし込むことで、分析の焦点が絞られ、後の施策にもつなげやすくなります。

- 売上向上

「新規顧客を増やしたい」

→「ECサイトの転換率を月10%向上させる」

- 業務効率化

「出荷までの時間を短縮したい」

→「在庫処理のリードタイムを2日削減する」

- 顧客満足度の向上

「解約を減らしたい」

→「購入後3ヶ月以内の利用率を向上させる」

データを正しく理解する

分析に使うデータが、どのように作られたものなのかを理解することも非常に重要です。

- どのタイミングで取得されたデータなのか

- 入力ルールは統一されているか

- 欠損や誤入力はないか

といった点を無視して分析を進めると、結果の信頼性が揺らいでしまいます。

特に注意したいのは、「数字=事実」と思い込んでしまうことです。

データはあくまで人やシステムによって作られたものであり、その背景を理解することが、正しい分析の第一歩になります。

地味だが重要なクレンジング作業を怠らない

データ分析の現場では、前処理(データクレンジング)に最も多くの時間がかかると言われています。

具体的には、欠損値の処理、表記揺れの修正(全角・半角や略称の統一)、外れ値や異常値の確認といった作業が含まれます。

前処理をおろそかにすると、どれほど高度な分析手法を用いても結果の信頼性は担保できません。

逆に言えば、クレンジングの段階でデータを丁寧に整えれば、シンプルな分析でも十分に価値のあるインサイトを得られます。

仮説を立ててから分析する

データ分析で成果を出すためには、仮説を持って取り組むことが大切です。

「この数値が高いのは、〇〇が原因ではないか」

「この傾向は特定の顧客層に限られているのではないか」

といった形で、あらかじめ仮説を立てておくことで、分析の軸がブレにくくなります。

なお、仮説は必ずしも正しい必要はありません。

むしろ、予想と異なる結果が出た時にこそ、新たな気付きや発見につながることが多いのがデータ分析の面白いところです。

分析手法は目的に合ったものを選ぶ

データ分析では、つい高度な手法や機械学習に目が向きがちですが、本当に重要なのは「結果が現場に理解され、次のアクション(活用)につながるか」です。

シンプルな集計やグラフで十分に説明できるのであれば、それが最適な分析方法です。

逆に、精度が高くても解釈や説明が難しい分析は、現場で活用されにくい傾向があります。

「誰に(対象者)」「何を(目的)」「どのレベルで(解像度)」伝えたいのかを意識し、適切な手法を選択することが重要です。

分析結果を行動につなげる

データ分析は、レポートを作って終わりではありません。

重要なのは、分析結果を具体的なアクションにつなげることです。

- この結果から何が分かるのか

- どこを改善すればよいのか

- 何から優先的に取り組むべきか

といった観点で整理し、具体的な施策へ落とし込むことが重要です。

単に数字を並べるだけでなく、そこから導かれる意味や次の打ち手まで踏み込んで示すことで、データ分析は初めて意味を持ちます。

完璧よりも改善の積み重ねを大事にする

データ分析は、一度の取り組みで完結するものではなく、継続的に磨き上げていくプロセスです。

「仮説設定→実行→結果検証→改善」というサイクルを繰り返すことで、分析の精度と価値は徐々に高まっていきます。

最初から完璧を目指すのではなく、小さく始めて改善を積み重ねることが、結果的に成功への近道となります。

9.データ分析において情シス部門に求められる役割

データ分析を進めるうえで求められる情シス部門の役割は、単なる「システム管理・保守」にとどまりません。

むしろ、データ活用を支える「基盤づくり」と、ビジネスの成果につながるデータ活用をリードする「推進役」の両方が求められているといえます。

データ基盤の整備・運用

まず欠かせないのが、データ分析の基盤となる環境づくりです。

各システムに分散しているデータを収集・統合し、クレンジング処理を通じて分析に適した状態に整えることで、データ活用のスタートラインに立つことができます。

情シス部門がこうした基盤整備を中心に担うことで、現場部門は分析業務そのものに専念できる環境が実現します。

データの品質・ガバナンス管理

データ分析の精度は、元となるデータの品質に大きく左右されます。

そのため、データの正確性や一貫性を維持することも情シス部門の重要な役割です。

また、アクセス権限の管理やセキュリティ対策など、データを安全に活用するための仕組みづくりも欠かせません。

信頼性の高いデータ環境を維持することが、分析の価値を最大化します。

誰でも簡単に使える分析ツールの提供

現場部門がスムーズにデータ分析を行うためには、使いやすいツールと環境の整備が必要です。

BIツールやクラウドサービスの導入・運用、ノーコード/ローコードツールの活用支援などを通じて、誰もが気軽にデータを扱える環境を整えます。

専門知識の有無に関わらずデータへとアクセスできる状態を作ることが、データ活用の広がりを後押しします。

技術とビジネスの橋渡し

情シス部門には、技術とビジネスをつなぐ「橋渡し」としての役割も求められます。

依頼された内容に対応するだけでなく、現場部門の課題を理解し、どのようにデータを活用すれば解決できるのかを一緒に考えることも重要な役割です。

課題の整理や分析の方向性の提案など、ビジネスの現場により踏み込んだ「伴走型」の関わりが、データ活用の成果を大きく左右します。

データ活用のルール・文化づくり

データ分析を一部の担当者だけに属人化させず、組織全体に広げていくことも重要です。

そのためには、データの取り扱いルールを整備するとともに、社内教育やナレッジ共有を通じてITリテラシーの向上を図る必要があります。

環境を整えるだけでなく、「データを活用するのが当たり前」という文化を醸成することが求められます。

継続的な運用改善

データ活用の取り組みは、一度仕組みを構築して終わりではなく、継続的に改善していくものです。

ビジネス環境の変化に応じて、データ基盤や分析プロセスを見直し、より効果的な形へと進化させていく必要があります。

新しい技術の導入や運用の改善を通じて、データ活用の価値を高め続けることが情シス部門の役割といえます。

10.まとめ

いかがでしたでしょうか?

データ分析基盤の整備やデータ活用に不安を感じている企業様は、ぜひお気軽に当社コンピュータマネジメントへご相談ください。

当社では、システム企画・要件定義などの上流工程から、システム運用・保守、インフラ構築、セキュリティ対策まで、IT関連業務を幅広くサポートする「情シス支援サービスION」を展開しております。

AWSやAzureを活用し、それぞれの用途に合わせた最適なクラウド環境の設計・構築・保守はもちろん、データクレンジングにも対応可能です。

「どのデータを優先的に整備すればいいか分からない・・・」

「重複や表記ゆれの対応が大変そう・・・」

「既存システムとの連携や自動化に不安がある・・・」

「データ活用を推進するための組織体制が整っていない・・・」

といったお悩みにも柔軟に対応いたします。

データ管理や活用でお困りの際は、ぜひお気軽にご相談ください。

ICT × Optimization × Navigator = ION(イオン)

情シスが「1人で抱え込まない」環境を実現します

情シスの「誰か手伝って・・・」を現実に。

あなたの頼れる”ナビゲーター”として、共に最適解を見つけ出します。

システム企画から運用・保守、インフラ管理、セキュリティ対策、Microsoft 365活用まで、ITまわりの「困った」を幅広くサポートいたします。

「全部任せたい」も、

「この部分だけ手伝ってほしい」もOK。

専門性の高いものから定常的な作業まで、情シス業務の中から必要な部分だけを柔軟にご依頼いただけます。

お電話・FAXでのお問い合わせはこちら

03-5828-7501

03-5830-2910

【受付時間】平日 9:00~18:00

フォームでのお問い合わせはこちら

この記事を書いた人

Y.M(マーケティング室)

2020年に株式会社コンピュータマネジメントに新卒入社。

CPサイトのリニューアルに携わりつつ、会社としては初のブログを創設した。

現在は「情シス支援」をテーマに、月3本ペースでブログ更新を継続中。